ما هي سلبيات الذكاء الاصطناعي في البحث العلمي؟

يعتبر **الذكاء الاصطناعي** تقنية حديثة تساهم بشكل كبير في تطور **البحث العلمي**، ولكن له أيضًا جوانب سلبية يجب النظر إليها بعناية. في هذا المقال، سنستعرض بعض من تلك السلبيات ونناقش تأثيراتها على العملية البحثية.

زيادة الاعتماد على التكنولوجيا

تؤدي **زيادة الاعتماد على الذكاء الاصطناعي** في البحث العلمي إلى فقدان المهارات التقليدية لدى الباحثين. ففي بعض الحالات، قد يؤدي الاعتماد المفرط على هذه التقنية إلى تقليل القدرات التحليلية والإبداعية للباحثين. على سبيل المثال، إذا اعتاد الباحثون على استخدام الخوارزميات لتحليل البيانات، فقد يصبحون أقل قدرة على فهم البيانات بأنفسهم أو على تطوير أفكار جديدة دون مساعدة الخوارزميات.

مخاوف من الجودة والدقة

تسهم **التقنيات الذكية** بطرق متعددة في تحسين جودة الأبحاث، ولكن هناك مخاوف كبيرة تتعلق بالدقة. فبعض الخوارزميات قد تنتج نتائج غير دقيقة أو متحيزة، مما يمكن أن يؤثر سلبًا على نتائج البحث. وفقًا لبحث منشور في *مجلة الذكاء الصناعي*، تعتبر البيانات المستخدمة لتدريب الخوارزميات أساسية، وفقدان موثوقيتها قد يؤدي إلى نتائج مضللة. (للمزيد من المعلومات، يمكن الاطلاع على ويكيبيديا).

الأخلاقيات والقضايا الاجتماعية

تثير التقنيات المعتمدة على **الذكاء الاصطناعي** قضايا أخلاقية مهمة، خاصة عند استخدامها في المجالات الطبية أو العلمية. على سبيل المثال، يمكن أن يؤدي التطبيق غير الأخلاقي لهذه التقنيات إلى انتهاكات لحقوق الأفراد، مثل الخصوصية وحقوق البيانات. في بعض الأحيان، قد يتم استخدام الذكاء الاصطناعي لتحليل بيانات الأشخاص دون إذنهم، مما يثير مشاكل قانونية وأخلاقية. تعتبر هذه القضايا مواضيع بحثية هامة في سياق الذكاء الاصطناعي وطرقه الجديدة في البحث العلمي.

تحديات التكلفة والتمويل

قد تتطلب **تكنولوجيا الذكاء الاصطناعي** استثماراً كبيراً في تطوير الأنظمة والأدوات. المشاريع البحثية التي تعتمد على الذكاء الاصطناعي قد تحتاج إلى ميزانيات ضخمة، مما يجعل الوصول إليها محدودًا بالنسبة لبعض الباحثين أو المؤسسات البحثية الصغيرة. وفقًا لتقرير صادر عن *مؤسسة العلوم الوطنية*، قد تتسبب تكلفة هذه الأنظمة في تفاقم التفاوت في الوصول إلى الموارد البحثية (تفاصيل أكثر على موقع المؤسسة).

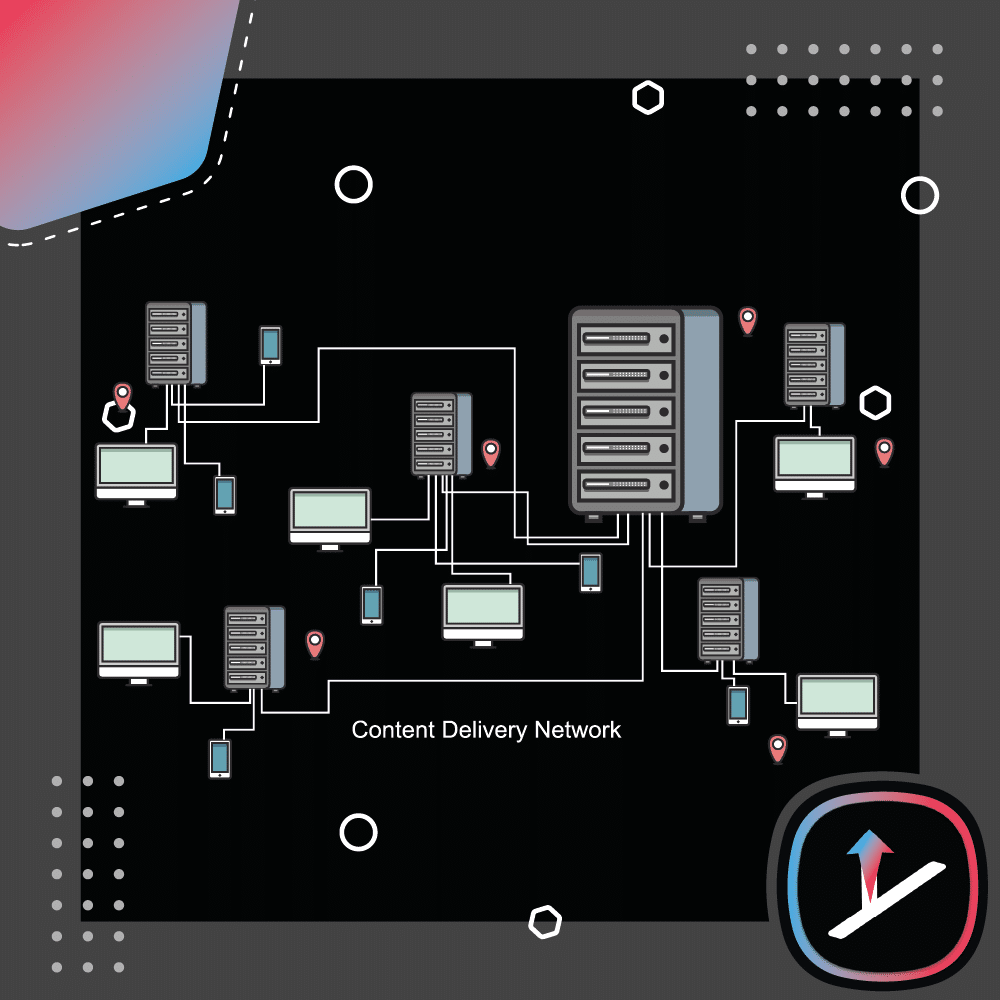

قضايا الأمن السيبراني

تزايد الاعتماد على **الذكاء الاصطناعي** يعقد أيضًا قضايا الأمن السيبراني. فقد تكون الأنظمة المعتمدة على الذكاء الاصطناعي عرضة للهجمات الإلكترونية أو الاختراقات، مما يمكن أن يؤدي إلى تسرب المعلومات الحساسة أو التلاعب بالبيانات. لذلك، يتطلب الأمر تطوير أنظمة أمان معقدة لحماية هذه المعلومات، وهو الأمر الذي قد يكون تحديًا كبيرًا للعديد من المؤسسات.

إمكانية التحيز في البيانات

تعتبر **التحيزات** في البيانات المستخدمة لتدريب الخوارزميات مشكلة خطيرة. إذا كانت البيانات غير متوازنة أو تحتوي على تحيزات، فإن النتائج الناتجة عن الخوارزميات قد تعكس هذه التحريفات، مما قد يؤدي إلى استنتاجات غير صحيحة. هذا يمثل تحديًا كبيرًا في الأبحاث التي تعتمد بشكل كبير على الذكاء الاصطناعي، كالمجالات الطبية والاجتماعية.

عدم القدرة على الفهم والتفكير النقدي

قد تنتج أنظمة **الذكاء الاصطناعي** معلومات قد تكون صحيحة ولكن يتعذر تفسيرها. وهذا يعني أن الباحثين قد لا يعرفون السبب وراء إصدار النظام لنتائج معينة، مما يؤدي إلى نقص في التفكير النقدي والفهم العميق للمواد التي يتم البحث فيها. تؤثر هذه الظاهرة سلبًا على جودة الأبحاث، حيث تفتقد إلى القدرة على تفسير النتائج بشكل شامل.

تأثيرات اقتصادية سلبية

في بعض الأحيان، قد يؤدي اعتماد التكنولوجيا الجديدة إلى فقدان وظائف تقليدية. في سياق الأبحاث، يمكن أن تؤدي الأتمتة المعتمدة على الذكاء الاصطناعي إلى تقليص عدد العمالة البشرية المطلوبة، مما يثير مخاوف بشأن البطالة. كما أشار بحث من *منظمة العمل الدولية* أن استخدام التكنولوجيا الحديثة قد يزيد من الفجوة الاقتصادية بين الدول المتقدمة والدول النامية.

خاتمة

على الرغم من فوائد **الذكاء الاصطناعي** في تعزيز البحث العلمي، فإن هناك عددًا من السلبيات التي يجب أن نكون واعين لها. من زيادة الاعتماد على التكنولوجيا إلى القضايا الأخلاقية والسلوكية، يحتاج المجتمع الأكاديمي إلى التعامل مع هذه التحديات بعناية. يتطلب الأمر توازنًا بين الاستفادة من هذه التقنيات وضرورة ضمان الجودة والأمان والأخلاقيات في الأبحاث العلمية.